Depuis 2023-2025, une nouvelle génération d’attaques combine ingénierie sociale et clonage vocal par IA : le vishing. La voix du dirigeant devient un vecteur d’attaque et le phénomène prend de l’ampleur. Avec l’IA, cloner une voix devient un jeu d’enfant. Nul besoin de compétences particulières, hormis celle du bluff.

Imaginez, il suffit de 3 secondes d’audio pour obtenir un résultat exploitable avec environ 85% de similarité avec l’original. Entre 10 et 30 secondes, le résultat est quasi parfait. Alors, qu’est-ce qui pourrait empêcher les hackers d’industrialiser cette arnaque ?

A nous de nous prémunir. Dans cet article :

- Un aperçu de l’ampleur du phénomène et de ses conséquences

- Profil des attaquants

- Leur modus operandi en 3 étapes

- Quelques mesures pour se protéger

Ampleur du phénomène et conséquences du Vishing

Une accélération documentée

Les attaques de type vishing connaissent une croissance beaucoup plus rapide que le phishing par email. Plusieurs rapports convergent :

- Selon des analyses de threat intelligence compilées par IBM et des acteurs SOC européens, les attaques de vishing ont progressé de plus de 400 % entre 2023 et 2025, avec une part croissante impliquant des voix synthétiques réalistes.

- Le FBI (IC3 Report) confirme une hausse continue des fraudes BEC (Business Email Compromise), dont une part significative bascule désormais vers le canal vocal, jugé plus efficace pour contourner les contrôles.

- En Europe, Europol classe le deepfake vocal parmi les menaces cyber émergentes majeures, notamment pour les PME et ETI peu outillées sur les procédures internes.

Des impacts financiers et organisationnels

Les conséquences sont rarement limitées à une perte financière immédiate :

- Fraudes financières : virements urgents, modifications de RIB, validation de paiements hors procédure.

- Compromission d’identités : réinitialisation de MFA ou divulgation d’informations internes lors d’appels.

- Crise de confiance interne : remise en cause de l’autorité du dirigeant, suspicion généralisée.

- Risque juridique et réputationnel : défaut de contrôle interne, exposition réglementaire.

Cas documentés :

- En 2024, Mark Read, PDG de WPP (un des plus grands groupes de communication et publicité au monde), a été ciblé par une tentative de fraude sophistiquée utilisant une imitation vocale par IA combinée à de faux éléments visuels via WhatsApp et Teams.

L’attaque visait un cadre pour l’inciter à effectuer une action (argent / création de business) en se faisant passer pour l’exécutif. L’opération a été contrée de justesse grâce à la vigilance interne, mais elle illustre que même les plus hauts dirigeants sont ciblés par des deepfake scams impliquant voix et visages générés par l’IA. - Janvier 2026 en Suisse : Un entrepreneur suisse a été dupé en transférant plusieurs millions de francs suisses suite à des appels utilisant une voix manipulée par IA présentée comme celle d’un partenaire de confiance. L’affaire est en cours d’enquête.

Profils des attaquants

Contrairement aux clichés, il ne s’agit pas majoritairement de « génies de l’IA ».

Trois profils dominants

- Groupes de cybercriminalité financière organisée

Actifs sur le BEC, ils ont intégré le clonage vocal comme outil supplémentaire, peu coûteux et très rentable. - Fraudeurs opportunistes outillés

Individus ou petits groupes utilisant des plateformes commerciales de clonage vocal, sans compétence avancée en machine learning. - Prestataires criminels “as-a-service”

Certains acteurs proposent désormais du voice cloning on demand, à la manière du phishing-as-a-service. Un vrai marché parallèle.

La barrière technique est basse. Ce sont les scénarios sociaux et organisationnels qui font la différence.

Comment ils s’y prennent en 3 étapes

Étape 1 — Collecte de la voix

Les sources ne manquent pas :

- vidéos LinkedIn, YouTube, conférences, webinaires,

- interviews presse, podcasts,

- messages vocaux internes,

- parfois un simple appel « prétexte » pour faire parler la cible.

👉 10 à 30 secondes de voix suffisent aujourd’hui pour produire un clone exploitable.

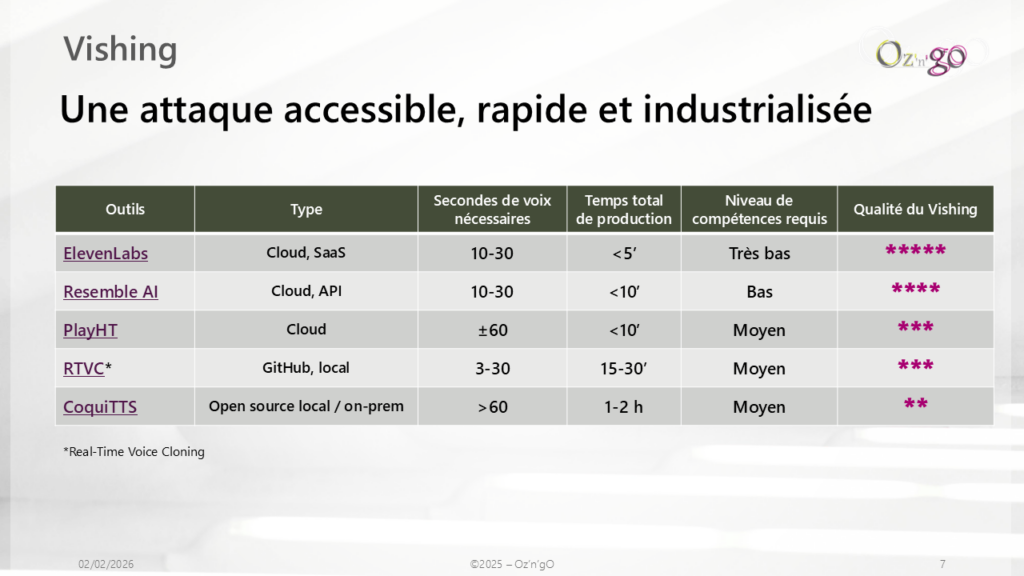

Étape 2 — Entraînement du modèle vocal

Ensuite, facile. Les attaquants utilisent des plateformes commerciales de clonage vocal (cloud) ou des outils open source exécutés localement.

Elles fonctionnent toutes sur le même principe :

- extraction de la signature vocale (speaker embedding),

- apprentissage du timbre, rythme, prosodie,

- génération d’un modèle capable de parler n’importe quel texte avec cette voix.

Étape 3 — Appel frauduleux

Enfin, ils passent à la phase « attaque » selon deux modes :

- Text-to-Speech : script préparé (ordre, validation, urgence).

- Voice-to-voice quasi temps réel : dialogue interactif.

L’efficacité repose sur trois principes bien connus et bien rodés :

- l’urgence,

- l’autorité hiérarchique,

- la cohérence contextuelle (voyage, réunion, crise).

Pourquoi ça marche (encore)

Trois raisons majeures :

- L’oreille humaine est peu fiable face aux voix synthétiques réalistes.

- La voix déclenche un réflexe de confiance plus fort que l’email ou le texte.

- Beaucoup d’organisations n’ont aucune règle formalisée sur ce qu’un dirigeant peut ou ne peut pas demander par téléphone.

Résultat : la voix devient un facteur d’authentification implicite, alors qu’elle ne l’est plus.

Mesures concrètes pour se protéger

Parlons peu, parlons bien. Trois types de mesures.

Mesures organisationnelles (prioritaires)

- Interdiction formelle de toute validation sensible par téléphone seul.

- Mise en place d’un double canal obligatoire (appel + message interne, ou appel + validation écrite).

- Définition de phrases ou codes internes pour les situations critiques (simples, non publics).

- Délai incompressible pour tout virement exceptionnel, même « urgent ».

Mesures humaines

- Sensibilisation ciblée des fonctions à risque : finance, assistanat de direction, IT, RH.

- Exercices de simulation de vishing.

Mesures techniques (complémentaires)

- Journalisation et traçabilité des demandes sensibles.

- Surveillance des appels entrants à caractère anormal.

- L’authentification vocale peut constituer un premier signal, mais elle doit impérativement être combinée à une autre mesure indépendante pour toute action sensible.